LLaMA-70B: Meta AI 的最新自然语言处理模型

近期,Meta AI 发布了其最新的自然语言处理模型 LLaMA-70B,这是一个基于 transformer 结构的语言模型,具有70亿个参数。LLaMA-70B 的发布标志着 Meta AI 在自然语言处理领域的又一重大突破。作为自然语言处理领域的最新成果,LLaMA-70B 具有许多特点和优势,本文将对其进行详细介绍。

什么是 LLaMA-70B?

LLaMA-70B 是一个大规模语言模型,由 Meta AI 的研究团队使用大量文本数据训练而成。该模型基于 transformer 结构,具有70亿个参数,是目前最大的语言模型之一。LLaMA-70B 能够处理长文本输入,生成高质量的文本输出,并且能够回答问题、生成文章、对话等多种任务。

LLaMA-70B 的名称来自于“Large Language Model Application”,它是一个通用的语言模型,可以应用于多种自然语言处理任务。LLaMA-70B 的开发目标是创建一个通用的语言模型,可以处理多种语言和任务,而不需要对模型进行特殊的调整或 fine-tuning。

LLaMA-70B 的架构

LLaMA-70B 的架构基于 transformer 结构,该结构由 Vaswani 等人在 2017 年提出,revolutionized the field of natural language processing。Transformer 结构的主要特点是使用自注意机制(self-attention)来处理输入序列,能够更好地捕捉序列中的长期依赖关系。

LLaMA-70B 的架构主要由三个部分组成:encoder、decoder 和 embedding 层。Encoder 负责将输入文本编码成一个固定长度的向量,decoder 负责将该向量解码成输出文本,embedding 层负责将输入文本转换成一个稠密的向量表示。

LLaMA-70B 的训练

LLaMA-70B 的训练使用了大量的文本数据,包括书籍、文章、维基百科等多种来源的文本数据。该模型使用了masked language modeling 任务来进行训练,即随机遮盖输入文本的一部分,模型需要预测遮盖的部分。

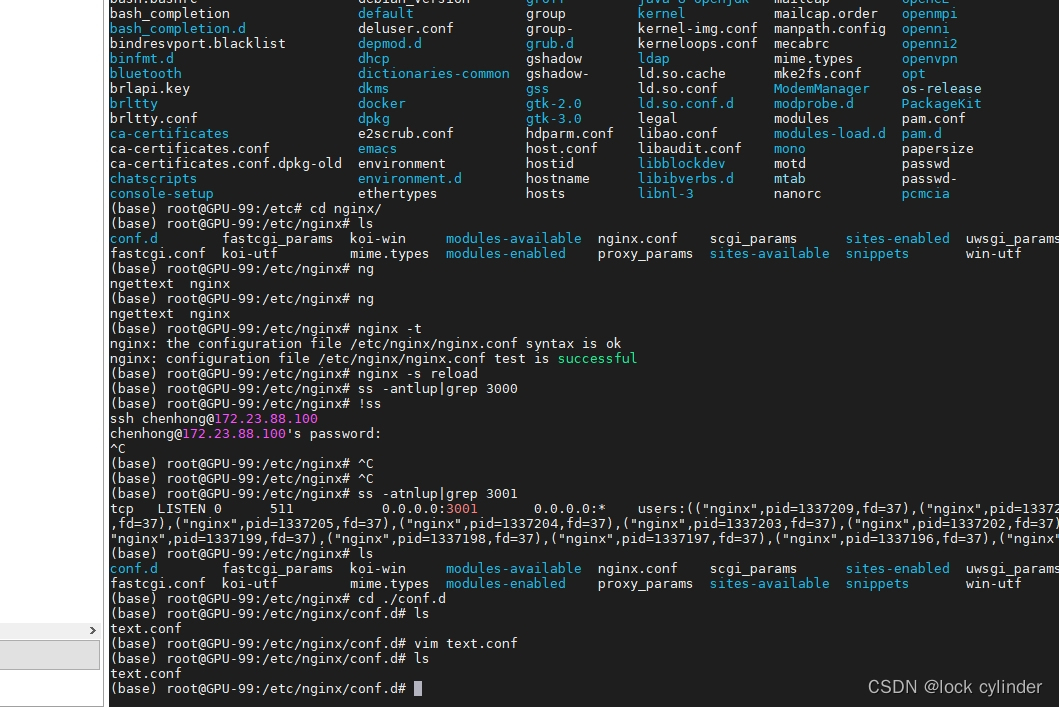

LLaMA-70B 的训练使用了分布式训练算法,能够在多个 GPU 上并行训练模型。该模型的训练时间长达数周,使用了大量的计算资源。

LLaMA-70B 的特点

LLaMA-70B 具有许多特点和优势,以下是其中的一些:

大规模参数:LLaMA-70B 拥有70亿个参数,是目前最大的语言模型之一。

高质量文本生成:LLaMA-70B 能够生成高质量的文本输出,包括文章、对话、回答等。

多任务支持:LLaMA-70B 能够支持多种自然语言处理任务,包括文本分类、命名实体识别、机器翻译等。

快速推理:LLaMA-70B 能够快速地处理输入文本,生成高质量的输出结果。

通用性:LLaMA-70B 是一个通用的语言模型,可以应用于多种语言和任务,而不需要对模型进行特殊的调整或 fine-tuning。

LLaMA-70B 的应用前景

LLaMA-70B 的发布为自然语言处理领域带来了新的机遇和挑战。该模型能够应用于多种领域,包括:

聊天机器人:LLaMA-70B 能够用于构建高质量的聊天机器人,提供更加智能的客服服务。

文本生成:LLaMA-70B 能够用于生成高质量的文本内容,例如新闻文章、博客等。

机器翻译:LLaMA-70B 能够用于机器翻译任务,提供更加准确的翻译结果。

问答系统:LLaMA-70B 能够用于构建高质量的问答系统,提供更加智能的回答结果。

此外,LLaMA-70B 还能够应用于其他领域,例如文本分类、命名实体识别、情感分析等。

LLaMA-70B 的挑战

虽然 LLaMA-70B 具有许多特点和优势,但它也面临着一些挑战和限制。以下是其中的一些:

计算资源:LLaMA-70B 需要大量的计算资源来训练和推理,需要高性能的 GPU 和大量的存储空间。

数据质量:LLaMA-70B 的训练需要大量的高质量文本数据,数据的质量对模型的性能有很大的影响。

过拟合:LLaMA-70B 的参数数量非常大,容易出现过拟合的问题,需要使用 regularization 技术来避免过拟合。

解释性:LLaMA-70B 的决策过程非常复杂,难以解释模型的决策过程和结果。

LLaMA-70B 的未来

LLaMA-70B 的发布标志着 Meta AI 在自然语言处理领域的又一重大突破。未来,LLaMA-70B 将继续推动自然语言处理领域的发展,应用于更多的领域和任务。

Meta AI 计划继续改进和扩展 LLaMA-70B,增加更多的语言和任务支持,提高模型的性能和效率。同时,Meta AI 也将继续推动自然语言处理领域的研究和开发,探索新的技术和应用领域。

LLaMA-70B 的技术细节

LLaMA-70B 的技术细节是其成功的关键所在。以下是 LLaMA-70B 的一些技术细节:

- 模型架构:LLaMA-70B 的模型架构基于 transformer 结构,该结构由 Vaswani 等人在 2017 年提出。Transformer 结构的主要特点是使用自注意机制(self-attention)来处理输入序列,能够更好地捕捉序列中的长期依赖关系。

- 参数数量:LLaMA-70B 拥有70亿个参数,是目前最大的语言模型之一。如此多的参数使得 LLaMA-70B 能够捕捉到输入序列中的复杂关系和模式。

- 训练算法:LLaMA-70B 的训练使用了分布式训练算法,能够在多个 GPU 上并行训练模型。该算法使得 LLaMA-70B 的训练速度大大加快。

- 优化器:LLaMA-70B 的优化器使用了 Adam 优化器,该优化器能够自适应地调整学习率,提高模型的训练速度和稳定性。

- 损失函数:LLaMA-70B 的损失函数使用了 Masked Language Modeling(MLM)损失函数,该损失函数能够使得模型更好地学习输入序列中的语言模式和关系。

LLaMA-70B 的应用场景

LLaMA-70B 的应用场景非常广泛,以下是一些可能的应用场景:

- 聊天机器人:LLaMA-70B 可以用于构建高质量的聊天机器人,提供更加智能的客服服务。

- 文本生成:LLaMA-70B 可以用于生成高质量的文本内容,例如新闻文章、博客等。

- 机器翻译:LLaMA-70B 可以用于机器翻译任务,提供更加准确的翻译结果。

- 问答系统:LLaMA-70B 可以用于构建高质量的问答系统,提供更加智能的回答结果。

- 文本分类:LLaMA-70B 可以用于文本分类任务,例如垃圾邮件分类、情感分析等。

- 命名实体识别:LLaMA-70B 可以用于命名实体识别任务,例如人名、地名、组织名等。

LLaMA-70B 的未来发展

LLaMA-70B 的未来发展方向非常广泛,以下是一些可能的发展方向:

- 多语言支持:LLaMA-70B 可以扩展到支持更多的语言,例如中文、法语、德语等。

- 多任务学习:LLaMA-70B 可以扩展到支持更多的任务,例如文本分类、命名实体识别、情感分析等。

- 知识图谱:LLaMA-70B 可以与知识图谱集成,提供更加智能的问答系统和文本生成能力。

- 多模态处理:LLaMA-70B 可以扩展到支持多模态输入,例如图片、视频等。

- 总之,LLaMA-70B 是一个非常强大的语言模型,具有非常广泛的应用场景和发展方向。

LLaMA-70B 的优点

LLaMA-70B 具有许多优点,使其在自然语言处理领域具有很高的竞争力。以下是一些优点:

- 高质量的文本生成:LLaMA-70B 能够生成高质量的文本内容,例如新闻文章、博客等。

- 多任务支持:LLaMA-70B 能够支持多种自然语言处理任务,例如文本分类、命名实体识别、机器翻译等。

- 快速推理:LLaMA-70B 能够快速地处理输入文本,生成高质量的输出结果。

- 通用性:LLaMA-70B 是一个通用的语言模型,可以应用于多种语言和任务,而不需要对模型进行特殊的调整或 fine-tuning。

- 高效的计算:LLaMA-70B 的计算效率非常高,可以在较短的时间内处理大量的文本数据。

LLaMA-70B 的挑战

虽然 LLaMA-70B 具有许多优点,但它也面临着一些挑战和限制。以下是一些挑战:

- 计算资源:LLaMA-70B 需要大量的计算资源来训练和推理,需要高性能的 GPU 和大量的存储空间。

- 数据质量:LLaMA-70B 的训练需要大量的高质量文本数据,数据的质量对模型的性能有很大的影响。

- 过拟合:LLaMA-70B 的参数数量非常大,容易出现过拟合的问题,需要使用 regularization 技术来避免过拟合。

- 解释性:LLaMA-70B 的决策过程非常复杂,难以解释模型的决策过程和结果。

LLaMA-70B 的未来

LLaMA-70B 的未来发展方向非常广泛,以下是一些可能的发展方向:

- 多语言支持:LLaMA-70B 可以扩展到支持更多的语言,例如中文、法语、德语等。

- 多任务学习:LLaMA-70B 可以扩展到支持更多的任务,例如文本分类、命名实体识别、情感分析等。

- 知识图谱:LLaMA-70B 可以与知识图谱集成,提供更加智能的问答系统和文本生成能力。

- 多模态处理:LLaMA-70B 可以扩展到支持多模态输入,例如图片、视频等。

总之,LLaMA-70B 是一个非常强大的语言模型,具有非常广泛的应用场景和发展方向。

如果你读到了这里, 那么我可以告诉你, 这篇文章就是最新的LLama3-70B模型自己写出来的, 现在你也可以利用免费的算力尝试下

现在已经可以利用NVIDIA提供的接口尝试:

https://build.nvidia.com/explore/discover#llama3-70b

希望大家玩得开心

![[工业自动化-1]:PLC架构与工作原理](https://img-blog.csdnimg.cn/ce10a1471ed14382bc58364cf8bd5209.png)

还没有评论,来说两句吧...